ショートQ&Aコーナー

- Q:社内AIガイドラインを策定しないリスクはある?

A:情報漏えいや法的トラブルなどのリスクがある。 - Q:社内AIガイドラインの作成は何から始める?

A:利用目的と対象範囲を明確にするところから始める。 - Q:社内AIガイドライン作成のコツは?

A:スモールスタートで進めることや最新の法規制・トレンドを常に反映させることなど。

社内での生成AI導入、どう進めるべきかお悩みですか?

リスク回避と安全な活用の鍵は「社内AIガイドライン」です。

しかし、ゼロから策定するのは大変な作業です。

本記事では、情報漏えいなどのリスクを解説しつつ、コピーして使える「全15項目の詳細なひな形(テンプレート)」を、5つの作成ステップに沿って提供します。

すぐに使えるひな形をお探しの担当者様は、ぜひご覧ください。

目次

社内AIガイドラインを策定しない場合のリスク3選

社内AIの導入は、業務効率化の大きな可能性を秘めています。

しかし、明確なガイドラインなしに利用を開始するのは危険です。ルールがなければ、従業員は意図せず重大な問題を引き起こすかもしれません。

具体的には、以下の3つの重大なリスクが想定されます。

社内AIガイドラインを策定しないリスク

- 機密情報・個人情報の漏えい

- 著作権侵害による法的トラブル

- 不正確な回答による誤った意思決定

これらのリスクは、企業の信頼性や競争力に直接影響を与えます。

安全にAI導入を進めるために、それぞれチェックしてください。

リスク1:機密情報・個人情報の漏えい

社内AIガイドラインを策定しない場合のリスク1つ目は、機密情報・個人情報の漏えいです。

生成AIの利用は、情報漏洩のリスクを伴います。

多くのAIモデルは、入力された情報を学習データとして利用するからです。

例えば、従業員が機密情報を含む会議の議事録をAIに要約させた場合を考えます。

その情報がAIの学習に利用され、外部に流出する恐れがあります。

社内AIガイドラインで入力すべきでない情報を明確に定義することが不可欠です。

.png)

リスク2:著作権侵害による法的トラブル

社内AIガイドラインを策定しない場合のリスク2つ目は、著作権侵害による法的トラブルです。

AIが生成したコンテンツが、他者の著作権を侵害する可能性があります。

AIはインターネット上の膨大なデータを学習して回答を生成するため、AIの回答が既存の著作物と酷似してしまうケースがあり得ます。

生成されたテキストや画像をそのまま業務で利用すると、意図せず著作権を侵害し、法的な紛争に発展しかねません。

ガイドラインでAI生成物のチェック体制を定めることが重要です。

.png)

リスク3:不正確な回答による誤った意思決定

社内AIガイドラインを策定しない場合のリスク3つ目は、不正確な回答による誤った意思決定です。

AIは時に誤った情報や不正確な回答を生成することがあり、これは「ハルシネーション」として問題視されています。

AIの回答を鵜呑みにすると、誤った情報に基づいた意思決定につながりかねません。

例えば、AIが作成した市場分析レポートの数値が間違っていた場合、経営戦略に悪影響を及ぼすでしょう。

AIの回答は必ず人間がファクトチェックするというルールを設け、業務の非効率化を防ぐ必要があります。

.png)

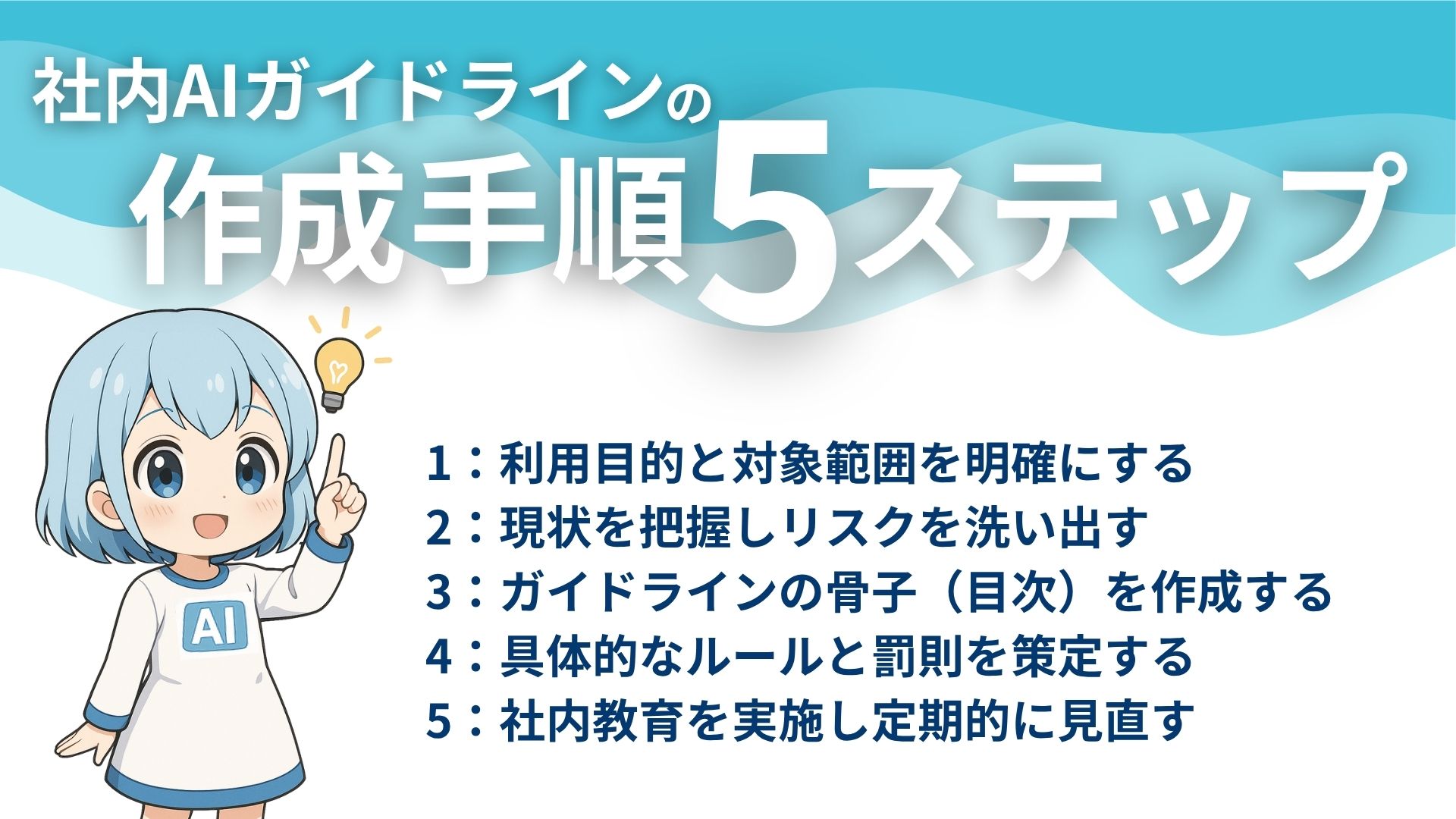

社内AIガイドラインの作成手順5ステップ

社内AIガイドラインの重要性は理解できても、何から手をつけるべきか悩む担当者も多いでしょう。

ガイドラインの策定は、場当たり的ではなく順序立てて進めることが成功の鍵となります。

実効性のある社内AIガイドラインを作成するために、以下の5つのステップを踏んで進めていきましょう。

社内AIガイドラインの作成手順

- 利用目的と対象範囲を明確にする

- 現状を把握しリスクを洗い出す

- ガイドラインの骨子(目次)を作成する

- 具体的なルールと罰則を策定する

- 社内教育を実施し定期的に見直す

この手順に従えば、自社の実態に合ったガイドライン導入が可能になるでしょう。

ステップ1:利用目的と対象範囲を明確にする

まず、社内でAIを「何のために」「誰が」利用するのかを定義します。

目的が曖昧なままでは、有効なルールを作れません。

例えば、顧客対応の効率化が目的なのか、社内文書作成の補助が目的なのかを明確にします。

利用目的を定めることで、ガイドラインで焦点を当てるべきリスクやルールが見えてきます。

.png)

ステップ2:現状を把握しリスクを洗い出す

次に、AI導入によって自社の業務にどのような影響が出るかを分析します。

各部署で想定されるAIの利用シーンをヒアリングしましょう。

そして、前述した情報漏えいや著作権侵害などのリスクが、どの業務で発生し得るかを具体的に洗い出します。

現状の業務フローとリスクを照らし合わせることが、実態に即したガイドライン作成につながるのです。

.png)

ステップ3:ガイドラインの骨子(目次)を作成する

洗い出したリスクに基づき、ガイドラインに盛り込むべき項目を決定します。

これは記事の構成案(目次)を作成する作業に似ています。

例えば、「基本方針」「利用ルール」「禁止事項」「罰則」などの大項目を立てましょう。

骨子を先に作ることで、記載すべき内容の漏れを防ぎ、体系だったガイドラインを構築できます。

.png)

ステップ4:具体的なルールと罰則を策定する

骨子(目次)に沿って、従業員が遵守すべき具体的なルールを定めます。

「機密情報は入力禁止」といった禁止事項だけでなく、「AIの回答は必ずファクトチェックする」といった利用手順も明記しましょう。

違反した場合の罰則も具体的に定めることで、ガイドラインの実効性を高められます。

.png)

ステップ5:社内教育を実施し定期的に見直す

ガイドラインは作成して終わりではありません。

従業員に内容を周知徹底させるための社内教育が必要です。

研修や説明会を実施し、AI利用の重要性と危険性を理解してもらいます。

また、AI技術は急速に進歩するため、ガイドラインも定期的に見直す必要があります。

最低でも半年に一度は内容を更新する体制を整えましょう。

.png)

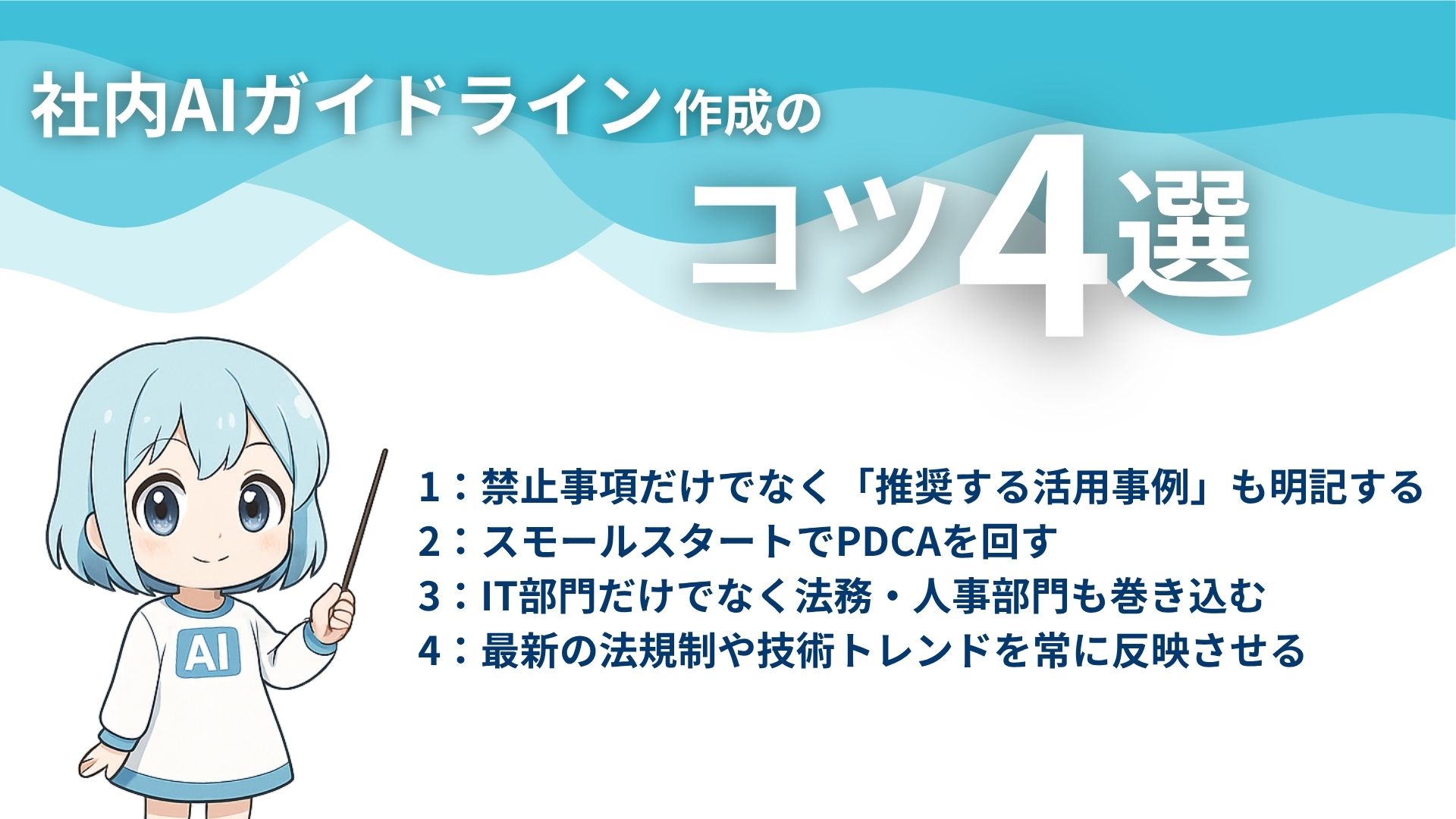

実効性のある社内AIガイドライン作成のコツ4選

社内AIガイドラインの作成ステップを理解したら、次は「使える」ガイドラインにするためのコツを押さえましょう。

ルールが複雑すぎたり、実態に合わなかったりすると、ガイドラインは形骸化してしまいます。

従業員が遵守しやすく、かつ企業をリスクから守るために、以下の4つのコツを意識してください。

社内AIガイドライン作成のコツ

- 禁止事項だけでなく「推奨する活用事例」も明記する

- スモールスタートでPDCAを回す

- IT部門だけでなく法務・人事部門も巻き込む

- 最新の法規制や技術トレンドを常に反映させる

これらの点を押さえることで、ガイドラインの導入がスムーズに進みます。

コツ1:禁止事項だけでなく「推奨する活用事例」も明記する

社内AIガイドライン作成のコツ1つ目は、禁止事項だけでなく「推奨する活用事例」も明記することです。

ガイドラインは、AI利用を制限するためだけのものではありません。

禁止事項ばかり羅列すると、従業員のAI活用意欲を削いでしまいます。

安全な範囲での「推奨される活用事例」も具体的に示しましょう。

例えば、「公開情報のみを使ったリサーチ」や「定型文のドラフト作成」などです。

活用を促進する側面も持つことが、AI導入を成功させる秘訣です。

.png)

コツ2:スモールスタートでPDCAを回す

社内AIガイドライン作成のコツ2つ目は、スモールスタートでPDCAを回すことです。

最初から全社一律の完璧なガイドラインを目指す必要はありません。

まずは特定の部署やチームで試験的に導入し、フィードバックを集めましょう。

実際に運用してみると、想定外の課題や必要なルールが見えてきます。

小さく始めて改善を繰り返す(PDCA)アプローチが、現実的なガイドライン定着への近道です。

.png)

コツ3:IT部門だけでなく法務・人事部門も巻き込む

社内AIガイドライン作成のコツ3つ目は、IT部門だけでなく法務・人事部門も巻き込むことです。

社内AIガイドラインの策定は、IT部門だけの仕事ではありません。

情報漏えいや著作権のリスクには法務部門の知見が不可欠です。

また、利用ルールや罰則の策定は、人事部門との連携が求められます。

関係各所を巻き込み、全社的なプロジェクトとして進めることが、実効性を担保するうえで重要です。

.png)

コツ4:最新の法規制や技術トレンドを常に反映させる

社内AIガイドライン作成のコツ4つ目は、最新の法規制や技術トレンドを常に反映させることです。

AIに関する技術や法律は、世界中で急速に変化しています。

昨日まで問題なかった利用方法が、明日には規制対象になるかもしれません。

ガイドラインが古くなると、新たなリスクに対応できなくなります。

最新の情報を常にキャッチアップし、ガイドラインを迅速に更新する体制を構築しておく必要があります。

.png)

社内AI導入ガイドラインのひな形

ここまでのステップとコツを踏まえ、社内AI導入ガイドラインの「ひな形(テンプレート)」をより実用的な形で紹介します。

自社の業種や規模、利用目的に合わせて、以下の[ ]内を修正・追記してご活用ください。

社内AI導入ガイドラインのひな形

- はじめに(基本方針と目的)

- 適用範囲

- 用語の定義

- 利用可能なAIツールと管理体制

- 利用時の基本原則(オプトアウト設定の義務化)

- 禁止事項(具体的な入力禁止情報)

- 推奨される活用事例と利用のヒント

- 利用シーン別の注意事項

- AI生成物の取り扱い(ファクトチェック・知的財産権)

- セキュリティとアカウント管理

- インシデント発生時の対応

- 教育・研修

- 罰則

- 相談窓口および見直しプロセス

- 附則(施行日・改訂履歴)

このひな形をベースに、自社独自の内容を肉付けしていきましょう。

1:はじめに(基本方針と目的)

冒頭に、ガイドラインのスタンスを明確にします。

禁止が目的ではなく、安全な活用を促進するためのルールであることを宣言します。

1. はじめに(基本方針と目的)

1-1. 基本方針

株式会社[自社名](以下「当社」という)は、生成AI技術の活用を、業務効率化および新たな価値創出のための重要な手段と位置づけます。本ガイドラインは、AI利用を禁止するものではなく、従業員が関連するリスクを正しく理解し、安全かつ効果的にAI技術を活用することを支援するために定めるものです。

1-2. 目的

本ガイドラインは、当社における生成AIの利用に関し、遵守すべき事項を定めることにより、情報漏洩、プライバシー侵害、著作権侵害等の法的・倫理的リスクを最小限に抑え、当社の企業価値と社会的信用を保護することを目的とします。

このセクションで、ガイドライン全体の方向性を定めます。

.png)

2:適用範囲

誰がこのルールを守るべきかを明確に定めます。

2. 適用範囲

本ガイドラインは、当社のすべての役員、正社員、契約社員、パート、アルバイト、派遣社員、その他当社の業務に従事するすべての人(以下「従業員」という)に適用されます。

雇用形態に関わらず、全員が対象であることを明記します。

.png)

3:用語の定義

解釈にズレが生じないよう、ガイドライン内で使用する重要な用語を定義します。

3. 用語の定義

(1) 生成AI(AI):

文章、画像、音声、コード等を自動生成する技術およびサービスの総称。(例:ChatGPT, Google Gemini, Microsoft Copilot, GitHub Copilot, Midjourney 等)

(2) 機密情報:

当社の経営戦略、財務情報、技術情報、人事情報、開発中の製品情報、その他社外秘と指定された一切の情報。および、取引先から受領した非公開情報。

(3) 個人情報:

個人情報保護法に定める「個人情報」。(例:顧客、従業員、取引先の氏名、住所、電話番号、メールアドレス、マイナンバー、生年月日、顔写真等)

自社の実態に合わせて、定義すべき用語を追加してください。

.png)

4:利用可能なAIツールと管理体制

セキュリティリスクを管理するため、会社が利用を許可するツールと禁止するツールを分類します。

4. 利用可能なAIツールと管理体制

4-1. ツールの分類

当社が業務で利用するAIツールを以下の通り分類します。

(1) 許可ツール(積極利用推奨):

当社が契約し、セキュリティ(入力情報を学習に利用しない設定等)を確認済みのツール。

(例:[当社契約のAIツールA(Microsoft Copilot等)])

(2) 要申請ツール(利用には承認が必要):

業務利用の必要性があり、IT部門がリスク評価を行った上で個別に許可するツール。利用希望者は[申請フォーム]からIT部門に申請すること。

(3) 禁止ツール:

上記(1)(2)以外の一切のAIツール。特に、個人契約のAIツールや、セキュリティが不明瞭な無料AIツールの業務利用を固く禁じます。

4-2. 管理体制

AIツールの導入・管理は[IT部門]が主管し、利用許諾の判断は[IT部門]および[法務部門]が連携して行います。

ツールの具体名は、自社の契約状況に合わせて更新します。

.png)

5:利用時の基本原則(オプトアウト設定の義務化)

情報漏えいを防ぐために非常に重要なルールです。

「入力情報をAIに学習させない」設定を義務化します。

5. 利用時の基本原則(オプトアウト設定の義務化)

AIツールの利用にあたっては、入力した情報がAIの学習に利用されないよう、以下の設定(オプトアウト設定)を必ず行うこと。

(1) [許可ツールA]の場合:

[具体的な設定手順(例:「チャット履歴とトレーニング」をオフにする)]

(2) [許可ツールB]の場合:

[具体的な設定手順]

※設定方法が不明な場合、または設定が不可能なツールを利用する場合は、必ず[IT部門]に相談すること。

この項目は非常に重要であり、ツールのアップデートに合わせて最新の設定方法を周知する必要があります。

.png)

6:禁止事項(具体的な入力禁止情報)

オプトアウト設定を行っていても、万が一のリスクに備え、入力すべきでない情報を具体的にリスト化します。

6. 禁止事項(具体的な入力禁止情報)

AIツールの利用設定(オプトアウト)に関わらず、以下の情報を入力することを固く禁じます。

(1) 個人情報(顧客、従業員、取引先の氏名、住所、電話番号、メールアドレス、マイナンバー、生年月日、顔写真等)

(2) 機密情報(当社の経営戦略、財務情報、技術情報、人事情報、開発中の製品情報等)

(3) 取引先から得た非公開情報、秘密保持契約(NDA)対象の情報

(4) 当社の非公開のソースコード、データベース情報

(5) その他、社外秘と指定された一切の情報

※業務上、機密情報や個人情報を含まない形でAIを利用したい場合は、情報を匿名化・一般化(例:具体的な社名を「A社」に置き換える等)した上で利用すること。

匿名化・一般化のルールも併記することで、実務での利用をサポートします。

.png)

7:推奨される活用事例と利用のヒント

禁止事項だけでなく、安全で効果的な活用事例(ユースケース)を具体的に示します。

これにより、従業員がAI活用を前向きに捉えられるでしょう。

7. 推奨される活用事例と利用のヒント

当社は、AIの積極的な活用を推奨します。以下に、リスクが低く、業務効率化が期待できる活用事例を示します。

(1) 情報の検索・要約:

公開情報(インターネット上の情報)に基づくリサーチ、長文の公開記事の要約。

例:業界の最新動向の調査、競合他社の公開情報の分析。

(2) アイデアの壁打ち(ブレインストーミング):

新しい企画のアイデア出し、プレゼンテーションの構成案の作成、キャッチコピーの提案。

(3) 定型文・ドラフト作成:

機密情報や個人情報を含まないメールのドラフト作成、社内通知のたたき台作成。

(4) 翻訳・語学学習:

公開されている外国語の文書の翻訳、英文メールの(機密情報を含まない)添削。

(5) 自己学習:

新しい技術用語の解説、プログラミングの基礎的な学習。

※これらの利用においても、第6条(禁止事項)および第9条(ファクトチェック)は必ず遵守すること。

このセクションで、従業員に「このように使ってほしい」という会社の意思を明確に伝えます。

.png)

8:利用シーン別の注意事項

業務でよく使われるシーンを想定し、特に注意すべき点を明記します。

8. 利用シーン別の注意事項

8-1. プログラミング・コード生成

AIが生成したコードには、第三者の著作権(特にGPLなどの厳格なOSSライセンス)を含むコードが混入する可能性があります。ライセンス違反を防ぐため、生成されたコードは必ず[チェックツール名]で確認し、安易に製品コードに組み込まないこと。

8-2. 社外向けコンテンツ作成(ブログ、SNS、プレスリリース等)

AIが生成したテキストや画像が、既存の著作物と酷似し、著作権侵害となるリスクがあります。生成物は必ず[コピーチェックツール名]で確認し、そのまま利用せず、必ず人間の手で大幅な修正・加筆(リライト)を行うこと。

8-3. 社内文書(議事録要約、メール作成等)

第6条(禁止事項)を遵守し、機密情報や個人情報を絶対に入力しないこと。

自社の業務で想定される他の利用シーンがあれば、項目を追加してください。

.png)

9:AI生成物の取り扱い(ファクトチェック・知的財産権)

AIの回答を鵜呑みにしないルールと、生成物の権利の帰属を明確にします。

9. AI生成物の取り扱い(ファクトチェック・知的財産権)

9-1. ファクトチェックの義務

AIは誤った情報や偏った情報を生成することがあります(ハルシネーション)。AIの生成物を業務で利用する場合は、その内容が正確かつ最新であるか、必ず人間がファクトチェック(事実確認)を行うこと。

9-2. AI利用の明示

社外に公開するコンテンツ(例:[具体的な開示対象物])において、AIが生成した内容を主要な部分として利用する場合は、[法務部門]に相談の上、必要に応じてAIを利用した旨を明示すること。

9-3. 知的財産権の帰属

従業員が当社の業務において、会社の許可したAIツールを利用して生成した成果物(文章、コード、画像等)に関する知的財産権は、原則として当社に帰属します。

権利の帰属を明確にすることは、企業の資産を守るうえで重要です。

.png)

10:セキュリティとアカウント管理

基本的なITセキュリティルールをAI利用においても徹底させます。

10. セキュリティとアカウント管理

(1) 許可されたAIツールの利用アカウントは適切に管理し、パスワードの使い回しを禁止します。

(2) 多要素認証(MFA)が設定可能な場合は、必ず設定してください。

(3) 公共のWi-Fiなど、安全性が確認できないネットワーク環境での業務利用は避けてください。

(4) 個人デバイス(BYOD)での利用は、当社の[モバイルデバイス管理規定]に従うこと。

なお、自社のセキュリティポリシーと整合性を取る必要があります。

.png)

11:インシデント発生時の対応

問題が起こったときに、隠蔽されず迅速に報告されるための体制を明記します。

11. インシデント発生時の対応

本ガイドラインへの違反、またはAI利用による情報漏洩、著作権侵害、その他セキュリティ上の問題(インシデント)が発生した、あるいはその疑いが生じた場合、従業員は速やかに[直属の上長]および[IT部門/セキュリティ担当窓口]に報告すること。

迅速な報告が被害を最小限に抑える鍵となります。

.png)

12:教育・研修

ガイドラインを「作って終わり」にしないため、教育の受講を義務化します。

12. 教育・研修

すべての従業員は、[IT部門]が指定するAI利用に関するセキュリティおよび倫理研修(e-learning等)を、[年1回]または入社時に必ず受講しなければなりません。

定期的な教育が、ルールの形骸化を防ぎます。

.png)

13. 罰則

ガイドライン違反に対する措置を明確にします。

13. 罰則

従業員が本ガイドラインに故意または重大な過失により違反し、当社に損害を与えた場合、就業規則に基づき、懲戒処分の対象となることがあります。

就業規則との関連性を明記します。

.png)

14:相談窓口および見直しプロセス

従業員が迷ったときの相談先と、ガイドラインの更新プロセスを定めます。

14. 相談窓口および見直しプロセス

14-1. 相談窓口

本ガイドラインの解釈、またはAI利用に関する不明点や懸念事項がある場合は、以下の相談窓口まで連絡すること。

IT部門ヘルプデスク(技術的な質問、アカウント管理、ツール申請)

法務部門(法的リスク、著作権、知的財産権に関する質問)

人事部門(ガイドラインの解釈、教育、罰則に関する質問)

14-2. ガイドラインの見直し

本ガイドラインは、AI技術の進展、関連する法規制の変更、および社内での利用状況の変化を踏まえ、[IT部門]および[法務部門]が中心となり、最低でも[半年に一度](または必要に応じて随時)見直しを行います。

相談窓口を明確にすることが、従業員の不安解消につながります。

.png)

15:附則(施行日・改訂履歴)

最後に、文書としての体裁を整えます。

15. 附則

202X年XX月XX日 制定

202X年XX月XX日 改訂(第2版)

これにより、常に最新版のガイドラインを参照するよう徹底できます。

.png)

社内での生成AI導入は専門家への相談もおすすめ

社内で生成AIを導入するには、ガイドラインの策定だけでなく、ツールの選定や社内教育の実施など、さまざまなステップを必要とします。

自社だけでAI導入を進め、運用体制を整えるのは困難でしょう。

社内で安全にAIを導入し、スムーズに運用していくためには、専門知識を持つ専門家へ相談するのも有効な選択肢です。

AI活用の第一相談所を担う「クラベルAI」では、AIの活用を考えている方と専門家とのマッチングサービスを展開しています。

AI活用における「誰に・何を・どう聞けばいいの?」というところからAIを使った大規模開発まで、何度でも無料で相談可能。

AI活用のことで何か気になることがある方は今すぐ無料相談をご活用ください。

なお、電話相談(03-6826-0562)も可能です。

.png)

ガイドラインを策定して社内での生成AI導入を円滑に進めよう

社内AIの導入は、正しく運用すれば業務を飛躍的に効率化させる力を持っています。

その強力な技術を安全に活用するためには、実効性のある「社内AIガイドライン」の策定が不可欠です。

本記事で紹介した作成ステップやひな形を参考に、自社の実情に合ったルール作りを進めてください。

策定プロセスでは、情報漏えいや著作権侵害といったリスクを確実に回避することが求められます。

もし自社だけでの対応に不安がある場合は、専門的な知見を持つ専門家へ相談するのもおすすめです。

クラベルAIでは、AI活用に関する無料相談を受け付けています。

「誰に・何を・どう聞けばいいの?」というところからAIを使った大規模開発まで、何度でも無料で相談できるので、AI活用をお考えの方はぜひ一度お問い合わせください。

社内AIガイドライン策定に関するよくある質問

最後に、社内AIガイドライン策定に関するよくある質問を紹介します。

従業員にガイドラインを遵守させるにはどうすればよいですか?

ガイドラインを遵守させるには、「教育」と「仕組み化」の両方が必要です。まず、全従業員を対象とした研修を実施し、ガイドラインの重要性とリスクを具体例とともに説明します。また、AI利用の申請プロセスを明確にし、誰がいつ何を利用したかを記録できる仕組みも有効です。罰則規定を設けるだけでなく、理解を深める努力が求められます。

従業員が個人契約したAIツールを業務で使ってもよいですか?

原則として禁止すべきです。 個人契約のAIツール(無料版を含む)は、会社がセキュリティ設定(オプトアウトなど)を一元管理できません。従業員が意図せず機密情報を入力し、それがAIの学習データとして利用されるリスクが非常に高くなります。シャドーITを防ぐためにも、ガイドラインで「会社の許可・契約したツールのみ業務利用可」と明確に定め、周知を徹底することが重要です。

\AIの導入・開発・相談なら【クラベルAI】に相談しよう!/